Décibels #1 : Désinformation : baissons le son, montons la garde

Le mix du mois : 👀 Les signaux faibles derrières Moltbook | 🔊 On monte le son sur les bulles de filtres | Des ressources pour comprendre la désinformation en ligne | 🧩 Un jeu pour décortiquer la viralité des fausses nouvelles | 📅 Quelques événements à ne pas manquer

En septembre 2025, le Conseil national du numérique est devenu le Conseil de l’IA et du numérique (CIANum). Aujourd’hui, c’est au tour de notre lettre d’information de faire peau neuve... tout en réduisant le volume. Le numérique, sans le bruit, c’est l’ambition de Décibels, la nouvelle lettre d’information mensuelle du CIANum, dont voici le tout premier numéro.

Bonne découverte !

Sourdine : la rubrique de veille anti acouphènes

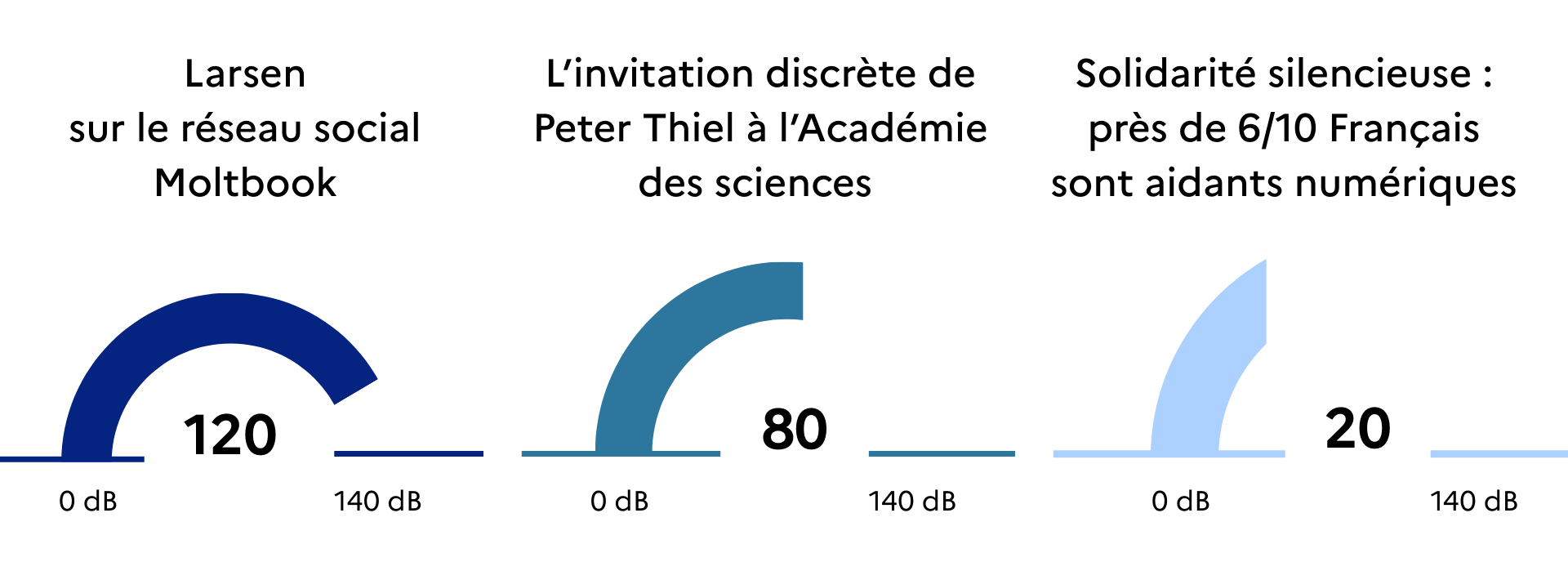

De 160 dB (saturation), 80 dB (conversationnel), ou 20 dB (signal faible), on analyse les bruits qui ont fait l'actualité récente en veillant à monter le son de ceux que l’on a insuffisamment entendus.

160 dB : Larsen sur Moltbook

🦞 En l'espace de quelques jours, le réseau social Moltbook est devenu la nouvelle coqueluche d’internet. Ce clone de Reddit mais officiellement « interdit aux humains », où les agents IA partagent, discutent et votent sous l’œil – mais sans contrôle – des humains. En seulement quelques jours, le site a attiré plus de 1,7 million d'agents, générant des centaines de milliers de posts et des millions de commentaires, il a même vu naître une langue et une religion censément générés artificiellement. De quoi faire saturer les ondes et inspirer les auteurs de science-fiction.

Les signaux faibles derrière le bruit

- Un Turc mécanique 3.0 : Selon la MIT Technology Review, l’autonomie affichée est un trompe-l’œil. Beaucoup des contenus viraux observés émanent en réalités d’humains infiltrés : les publications rédigées par des robots sont en fin de compte le résultat d’une intervention humaine dissimulée.

- Mimétisme et miroir de nos propres récits : Plutôt que le signe de l’avènement de l’intelligence artificielle générale, Moltbook serait le reflet des anxiétés humaines face à l’IA, peut-on lire dans un article d’Usbek & Rica. Alimentant nos biais de confirmation, ce système renforce pour certains la conviction que la machine finira par remplacer l’humain, quand d’autres y voient la confirmation qu’il ne s’agit que d’un théâtre artificiel. Ces peurs et imaginaires autour de l’IA sont loin d’être nouveaux et nourrissent d’ailleurs ces modèles qui s’entraînent sur nos scénarios de science-fiction. Mais comme Usbek & Rica le rappelle : « pendant qu’on alimente la panique collective liée aux soi-disant « super intelligences », on ne réfléchit pas aux vrais dangers liés à l’IA : le risque de standardisation et de prolétarisation de la pensée, son impact sur notre santé mentale, la fragilisation de l’économie liée à un modèle plus que fragile et pourtant soutenu aveuglément par les États et les investisseurs, sans oublier son coût écologique gigantesque. »

- Une opération marketing : L'ascension de Moltbook coïncide étrangement avec le lancement d'OpenClaw (ex-ClawdBot), un agent open source alimenté par LLM et exécuté localement sur PC.

80 dB : L’invitation discrète de Peter Thiel à l’Académie des sciences : un écho libertarien sous la coupole

Le 26 janvier 2026, l’Académie des sciences morales et politiques a accueilli, à huis clos, l’un des hommes les plus controversés de la Silicon Valley : Peter Thiel. Milliardaire libertarien, proche de J.D. Vance et cofondateur de Palantir Technologies, entreprise spécialisée dans la surveillance de masse et fournisseur de logiciels à l’ICE américaine à des fins de ciblage algorithmique, Thiel a été invité par la philosophe Chantal Delsol pour contribuer à un groupe de travail sur « l’avenir de la démocratie ». Ironie du sort, ce dernier est persuadé que la démocratie est un régime à proscrire.

Pendant 45 minutes, Thiel est venu distiller une fréquence apocalyptique sur l’Antéchrist, figure théologique qu’il associe à ceux qui freinent le progrès scientifique au nom de la paix ou de la sécurité. Ses thèses s’inscrivent dans le long-termisme, une idéologie prônant le bien-être futur de l’humanité, mêlant transhumanisme et colonisation spatiale. L’invitation de Thiel, symbole de l’influence d’une techno-élite aux ambitions politiques, interroge sur la place accordée à de telles idées au sein d’une institution républicaine.

20 dB : Solidarité silencieuse : près de 6 Français sur 10 sont aidants numériques auprès de leur entourage

C’est ce que révèle le Baromètre du numérique 2026, étude de référence, pilotée par l’Arcep , le Conseil général de l’économie (CGE), l’Arcom et l’ANCT - Agence nationale de la cohésion des territoires. Le soutien apporté est majoritairement d'ordre familial (36 % des répondants), suivi de l'aide aux amis ou voisins (21 %), puis aux collègues de travail ou d'études. Ces données sont confirmées par un autre indicateur : un Français sur deux a déjà assisté un proche pour une démarche administrative en ligne.

Ces résultats amènent plusieurs constats clés :

- L'essor de la dématérialisation des démarches administratives a mécaniquement accru le besoin d'accompagnement des publics les plus éloignés du numérique.

- En France, l'inclusion numérique repose en grande partie sur des solidarités de proximité, le cadre familial est privilégié en raison de la nature intime et confidentielle que recouvrent ces démarches. Les conseillers et médiateurs numériques jouent, eux aussi, un rôle clé d’accompagnement numérique de proximité pour pallier aux difficultés rencontrées par ces publics.

- Le cumul des difficultés : les freins techniques s'ajoutent à la complexité initiale des démarches administratives.

- La forte proportion d'aidants illustre l'importance du contact humain et la nécessité d'un accompagnement personnalisé pour favoriser l'appropriation des outils et des usages.

Le contrechant : la mélodie secondaire qui accompagne la principale

Alors qu’approchent les élections municipales, le moment est venu pour les citoyennes et les citoyens de pouvoir accéder à une information plurielle et diversifiée en ligne, ingrédient essentiel d’un débat démocratique sain. Qu’est-ce qui pourrait les en empêcher ? On monte le son sur les bulles de filtres.

Terme inventé par Eli Pariser, les « bulles de filtres » désignent le mécanisme par lequel les algorithmes des plateformes, réseaux sociaux ou moteurs de recherche, tendraient à ne proposer aux utilisateurs que des contenus alignés sur leurs préférences, opinions ou comportements antérieurs. En somme, vous ne sortez plus de votre bulle (virtuelle).

Quel impact en période électorale ? En limitant l’exposition à une diversité de points de vue, les bulles de filtre risqueraient de restreindre la capacité des citoyens à se forger une opinion éclairée, fondée sur une compréhension nuancée et plurielle des enjeux. Le concept de bulle de filtre a gagné en visibilité après l’élection présidentielle américaine de 2016, où le rôle des algorithmes dans la diffusion de désinformation et la polarisation de l’opinion publique a été mis en lumière. Par leur fonctionnement, les bulles de filtres pourraient renforcer la propagation de fausses informations, la circulation de contenus trompeurs ou l’influence de contenus politiques ciblés.

Mais le concept fait débat et l’analyse scientifique de ce phénomène et de son impact réel sur la société présente des difficultés méthodologiques, qui nécessitent de donner à la recherche les moyens d’y voir plus clair. Ce qui aiderait :

- Analyser les algorithmes de recommandation de contenus implique une collecte de données qui est rendue complexe par les restrictions imposées par les plateformes et par la nature même des algorithmes, qui adaptent les contenus en temps réel aux interactions des utilisateurs. Reproduire fidèlement l’expérience de navigation d’un utilisateur, tout en analysant les contenus proposés, est une tâche ardue ;

- La classification des contenus pose problème : il n’est pas toujours évident de distinguer, par exemple, une information fiable d’une désinformation (volontaire) ou d’une mésinformation (involontaire) ;

- Enfin, comment évaluer l’intentionnalité derrière la formation d’une bulle ? S’agit-il d’un choix délibéré des plateformes pour orienter l’opinion, ou d’une conséquence « naturelle » de l’économie de l’attention, où les algorithmes privilégient les contenus susceptibles de maximiser le temps passé sur l’application ? ;

- Le développement de l'intelligence artificielle renouvelle le débat. Les modèles d'IA ne sont pas neutres : ils portent les empreintes culturelles et les valeurs de leurs données d'entraînement. Aussi conçus pour être trop « empathiques » et répondre aux attentes des usagers, quitte à les conforter dans leurs idées, ils risquent d'accentuer cette hyper-individualisation de l'information.

Alors, autant que possible, n’hésitez pas à sortir de votre bulle.

Fréquences : une curation de contenus, pour prolonger la réflexion et vous fournir des liens utiles

Un livre, un compte à suivre, un rapport, un chercheur et une étude, pour comprendre et agir contre la désinformation.

📚Un livre : L’attaque des slips tueurs d’Élise Gravel, autrice-illustratrice québécoise. La bande dessinée explique avec humour aux enfants (à partir de 8 ans) les mécanismes et moteurs derrière la création de fausses informations et les moyens pour apprendre à les repérer. Utile pour les petits… mais aussi pour les grands !

📱Un compte à suivre : @FrenchResponse, le compte du Ministère de l'Europe et des Affaires étrangères qui résonne sur X. Pourquoi ça marche ? Outil de riposte dans la lutte informationnelle, le compte dénote par sa réactivité et son ton humoristique, direct très en phase avec les codes du réseau social : memes, gifs et références bien senties pour troller les trolls…avec leurs propres méthodes. Efficace. On aime.

🎯Une stratégie : la France renforce sa lutte contre les manipulations de l’information, et publie la première stratégie nationale de lutte contre les manipulations de l’information 2026-2030, élaborée sous l’égide du Secrétariat Général de la Défense et de la Sécurité Nationale. Elle vise :

- Le renforcement de la résilience de la Nation par le déploiement d’une stratégie de formation et de sensibilisation à grande échelle ;

- L’encadrement et la responsabilisation des plateformes en ligne et des services d’IA générative, en particulier en période électorale ;

- La consolidation des capacités nationales de veille, de détection, d’attribution et de réponse par la coordination diplomatique et militaire ainsi que la réponse judiciaire et l’émergence d’une filière française d’OSINT ;

- L’action avec des partenaires européens et internationaux pour préserver un espace informationnel libre, ouvert et sécurisé.

🔍 Un chercheur : À l'occasion d'un séminaire au PEReN, Thomas Renault, spécialiste de l'impact des réseaux sociaux par l'analyse textuelle, analyse dans son étude @Grok Is This True? LLM-Powered Fact-Checking on Social Media (2025) l'essor du fact-checking par l'IA générative sur X. Si les grands modèles de langage (en l’occurrence dans l’étude Grok et Perplexity) permettent une vérification massive et quasi instantanée des informations partagées en ligne, le chercheur souligne des limites critiques : une polarisation partisane marquée (les républicains préférant Grok, les démocrates Perplexity) et un risque de substitution des systèmes humains de vérification des faits. Thomas Renault alerte notamment sur le déclin des Community Notes au profit de réponses automatisées, moins visibles publiquement, craignant que l'opacité de ces modèles et leur usage partisan ne finissent par renforcer les chambre d'écho plutôt que de les briser.

📊Une étude : la 2ème édition de l'étude de l'Arcom sur les rapports qu'entretiennent les Français à l'information révèle qu’ils s’intéressent à l’information et s’informent massivement :

- 92 % des Français s’informent tous les jours ;

- 40 % paient pour s’informer ;

- Ils consultent en moyenne 9,2 sources d’information ;

- Les médias algorithmiques sont le principal accès à l’information pour 54 % des moins de 25 ans ;

- 58 % des Français craignent être exposés à de fausses informations sur les réseaux sociaux.

Le Sonar : le conseil pour augmenter ses pratiques numériques d’un demi-ton

🧩 Devenez un vrai désinformateur (pour de faux)

Bad news, le jeu interactif en ligne qui vous met dans la peau d’un créateur de fake news.

Développé en 2018 par un collectif de chercheurs et journalistes néerlandais, le jeu est simple : publier des fausses nouvelles sur les réseaux sociaux pour augmenter votre nombre d’abonnés tout en voyant chuter votre taux de crédibilité.

Le sous-titre : le jeu invite en fait à comprendre les mécanismes derrière la création de fausses informations et leur viralité, à savoir l’imitation, l’émotion, la polarisation, la conspiration, le discrédit et la provocation.

L’ADN du jeu repose sur la « théorie de l’inoculation » : en exposant le joueur à des tentatives de manipulations dont on grossit le trait pour mieux l’alerter, le jeu stimule ses défenses cognitives et le rend plus apte à déceler de futures fausses informations. L’exposition renforce la résilience, un peu comme un vaccin contre la désinformation, donc.

Jouez gratuitement sur getbadnews.com [en anglais].

L'interlude : une respiration dans le flux, des dates pour aller écouter, ou voir des choses

- Le 13 février marquait le lancement institutionnel de la première édition de la Semaine de l’IA pour Tous, qui se tiendra partout en France, du 18 au 24 mai 2026. L’initiative nationale, lancée par la ministre déléguée Anne Le Hénanff , et portée par La Mednum, Make.org foundation et Café IA, prévoit 1 500 événements, pendant une semaine, pour sensibiliser aux enjeux et impacts de l’IA, par le débat et la discussion. Vous pouvez d’ores et déjà proposer votre propre événement via ce lien.

- Du 10 février au 31 mars, les Safer Internet Days, organisés par Internet Sans Crainte / Tralalere, vous invitent à parler bien-être numérique en ligne, autour du slogan « Les écrans et toi… Comment ça va ? ». Vous pouvez contribuer directement à cette campagne en participant aux nombreux événements prévus, ou en organisant le vôtre.

- Le 23 mars, l’Observatoire de l’IA de l’Université Paris 1 Panthéon-Sorbonne vous donne rendez-vous pour la conférence « Social media and its impact on job opportunities ».

- Le 24 mars, la Direction interministérielle du numérique (DINUM) organise sa journée « l’Etat dans le nuage », destinée aux professionnels du monde de la tech et de la sphère publique pour partager leurs expertises sur l’évolution des enjeux stratégiques du cloud en France comme en Europe.

📻 Fin de transmission ! Merci pour votre lecture. Pour ne rien manquer des actualités du Conseil de l'IA et du numérique, restez à l'écoute ici et sur nos réseaux sociaux !