Décibels #2 : La protection des mineurs donne le ton

Au programme de Décibels ce mois-ci 🔊 160 dB pour AMI Labs, silence radio pour le Métavers | 👀 Le pluralisme algorithmique, contrechant de la protection des mineurs en ligne | 🧩 Une partition privée avec FantomApp | 📅 Les rendez-vous à ne pas manquer

Sourdine : la rubrique de veille anti acouphènes.

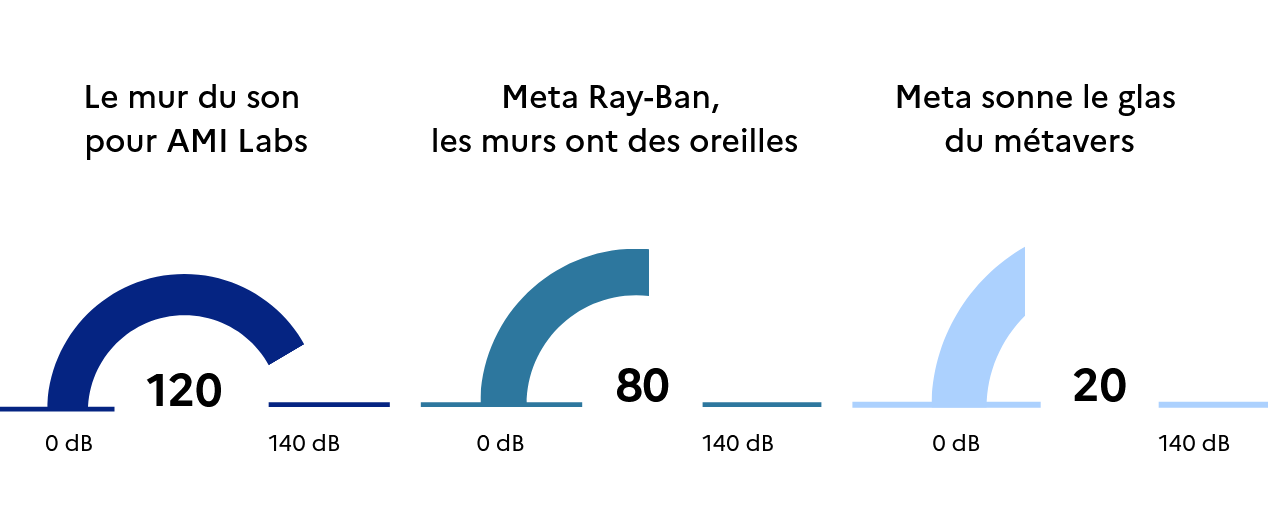

De 160 dB (saturation), 80 dB (conversationnel), ou 20 dB (signal faible),on analyse les bruits qui ont fait l'actualité récente en veillant à monter le son de ceux que l’on a insuffisamment entendus.

160 dB : Le mur du son pour AMI Labs

Après des mois de murmures dans les couloirs de la Silicon Valley, le signal est devenu pleinement audible ce mardi 10 mars 2026 : Yann LeCun, prix Turing et ex-figure de proue de Meta, lance officiellement AMI Labs (Advanced Machine Intelligence). Avec une levée de fonds record de 890 millions d’euros (1,03 milliard de dollars) et une valorisation immédiate à 3 milliards d’euros, la startup, nouveau poids lourd de l'IA, s’installe à Paris, avec trois autres bureaux à New York, Montréal et Singapour.

Filtrage des séquences : ce qu’il faut retenir

- Sortir du « tout-langage » : le pari de Le Cun est une rupture avec le bourdonnement actuel autour des Large Language Models – qui ne seraient « pas plus intelligents qu’un chat de gouttière ». Pour lui, l’avenir de l’IA ne réside pas dans le langage, mais plutôt dans la compréhension du monde physique. AMI Labs mise ainsi sur les « World Models » : des systèmes qui « ne cherchent plus à prédire un mot, mais un état, une situation » (Hanan Ouazan).

- La France, caisse de résonance : si le financement est international (Jeff Bezos, Nvidia, Softbank…), l'ancrage est stratégiquement tricolore. En attirant des investisseurs comme Xavier Niel, la famille Arnault ou Bpifrance, la levée de fonds d’AMI Labs prouve que l'écosystème français ne se contente pas de suivre la mesure.

- L’expertise au diapason : face aux discours prédisant un avenir trouble pour nos futurs diplômés sur le marché de l’emploi, Le Cun insiste : piloter ces systèmes complexes demandera des ingénieurs encore plus qualifiés en maths et physique.

80 dB : Meta Ray-Ban, les murs ont des oreilles

Dans une enquête conjointe publiée le 27 février, deux journaux suédois, le Svenska Dagbladet et le Göteborgs-Posten, révèlent les indiscrétions des lunettes connectées de Meta qui enregistrent silencieusement les scènes privées de leurs propriétaires. À Nairobi, les employés du sous-traitant Sama visionnent quotidiennement des scènes intimes ou encore des détails bancaires capturés à l’insu de leurs utilisateurs. L’IA n’est pas magique : la réalité est celle d’une annotation manuelle brute des données, par des employés kenyans, pour entrainer les modèles d’IA de Meta : « on voit tout, des salons aux corps nus ».

Les signaux faibles derrière le bruit :

- Le consentement, trou noir juridique ? Pour Kleanthi Sardeli, avocate spécialisée en protection des données pour l’ONG None Of Your Business, il y a un déficit de transparence : l'utilisateur ne réalise pas que chaque interaction avec l'IA déclenche un enregistrement potentiellement soumis à une « revue humaine ». Une fois les données injectées dans les modèles, l’utilisateur en perd le contrôle.

- Accorder les violons : les journalistes ont enquêté dans dix magasins d'optique à Stockholm et Göteborg. Les vendeurs s’y veulent rassurants et affirment que « tout reste localement dans l'application ». Fausse note majeure : les tests techniques réalisés par les rédactions prouvent le contraire.

- L’activité silencieuse des travailleurs du clic : le signal le plus persistant reste le recours des géants de la Tech aux travailleurs de pays à bas revenus, auxquels sont sous-traitées les tâches les plus pénibles et les moins rémunératrices. Des milliers de mains invisibles qui visionnent et annotent des contenus choquants pour quelques dollars.

20 dB : Meta sonne le glas du métavers

Alors que Meta dévoilait en fanfare son changement de nom en 2021 pour se concentrer sur le développement du métavers annoncé comme la « prochaine frontière », Mark Zuckerberg débranche discrètement l’épopée à 80 milliards de dollars sur laquelle il misait gros...

Que faut-il en retenir ?

- La plateforme au cœur du projet de ce monde virtuel, Horizon World, sera définitivement retirée des casques Quest (casques de réalité virtuelle Meta) le 15 juin pour se replier sur une application mobile.

- Cette mise en sourdine est, paradoxalement, une bouffée d'oxygène. Comme le soulignait déjà le média Reporterre en 2022, « l’essentiel du problème réside dans le coût en ressources de la fabrication ». Fabriquer ces casques VR exigent des besoins en métaux critiques (cuivre, or, lithium) dont l’extraction est en tension, et les techniques de recyclage très limitées.

- Une victoire silencieuse contre le technosolutionnisme ? Le métavers, tel que Mark Zuckerberg le concevait, n'a pas trouvé son public, faute d’utilité ? En déplaçant ses ressources vers l'intelligence artificielle et les lunettes connectées, Meta abandonne néanmoins l'immersion totale pour une technologie… pas forcément moins intrusive.

Le contrechant : la mélodie secondaire qui accompagne la principale.

Protection des mineurs en ligne : accorder les algorithmes sur le pluralisme

Cette année, les Safer Internet Days, nous invitent à nous interroger sur le bien-être et nos usages numériques, notamment chez les plus jeunes. Ceci dans un contexte où la France s’apprête à restreindre l’accès aux réseaux sociaux aux moins de 15 ans et où d’autres pays multiplient les initiatives pour protéger les mineurs en ligne.

Plusieurs outils sont mis en avant : le contrôle de l’âge, bien évidemment, mais aussi les interfaces dédiées aux mineurs, des obligations de modération renforcées pour les plateformes ou encore une réflexion ouverte sur le statut juridique de ces acteurs, entre hébergeur et éditeur.

En complément de ces propositions, la mélodie du pluralisme algorithmique monte crescendo. Alors que les algorithmes de recommandation et de modération sont aujourd’hui au service d’un modèle économique néfaste fondé sur la captation attentionnelle et, de fait, l’exposition à des contenus toxiques, le pluralisme algorithmique propose de redonner la main aux utilisateurs en leur permettant de paramétrer, voire choisir leurs algorithmes. Qu’est-ce que c’est ?

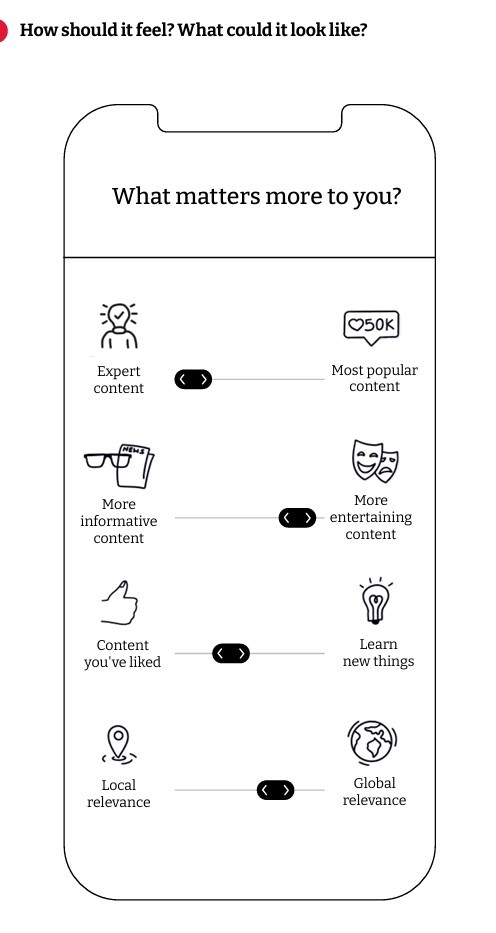

Portée par de nombreux acteurs français (comme les États généraux de l’information ou la commission d’enquête parlementaire sur TikTok), européens (comme Article 19, People vs. Big Tech ou le Center for Countering Digital Hate) et internationaux (comme Cory Doctorow, Daphne Keller ou Francis Fukuyama), cette proposition pourrait trouver une pertinence particulière pour les mineurs. L’idée ? Donner aux parents et aux ados eux-mêmes le pouvoir de choisir comment les algorithmes sélectionnent et affichent les contenus et paramétrer leurs interfaces. Par exemple, des options de filtrage renforcé, des algorithmes conçus pour privilégier des contenus éducatifs ou adaptés à l’âge, ou encore des interfaces simplifiées et transparentes, pourraient limiter l’exposition à la désinformation, aux discours haineux ou aux contenus promotionnels de comportements à risque (comme les défis dangereux ou les troubles alimentaires). En outre, l’ouverture à des services tiers de modération, labellisés et contrôlés, permettrait de proposer des environnements numériques plus sûrs, où les règles de protection des mineurs seraient prioritaires et adaptables selon les besoins spécifiques de l’utilisateur. Certaines plateformes, comme Bluesky, expérimentent déjà des systèmes où les utilisateurs personnalisent leurs flux et leur modération.

La demande sociale se fait elle aussi plus pressante. 72 % des Français préfèreraient un affichage non personnalisé des contenus, selon le Baromètre du numérique 2026. Cette mesure pose néanmoins de nombreuses questions techniques, juridiques et économiques qu’il serait intéressant d’approfondir dans les mois à venir, par exemple dans la perspective du Digital Fairness Act en préparation.

A quoi ça pourrait ressembler ?

Le pluralisme algorithmique expliqué par la Panoptikon Foundation :

"Prototyping User Empowerment : towards DSA-compliant recommender systems".

Une rubrique de curation de contenus, pour prolonger la réflexion et vous fournir des liens utiles.

- 👧 Protection des mineurs : les ressources pédagogiques de l’Arcom et d’Internet sans crainte.

- 📚Une publication de Common Sense Media alerte sur les jouets IA, de plus en plus présents dans les chambres de nos enfants, déconseillés avant 6 ans et jugés risqués jusqu'à 12 ans pour le développement cognitif et émotionnel des jeunes enfants.

- 💡Kora : le premier comparatif indépendant conçu pour évaluer la sécurité des modèles d’IA pour les mineurs.

- 🌡️La publication du 4e baromètre de l’impact du numérique sur le développement des enfants.

- Adolescents & Anthropomorphic AI : Un rapport (en anglais) du iRAISE Lab et Everyone.AI pour repenser le design des IA conversationnelles et protéger l'autonomie des jeunes face aux agents « socialement fluides ».

- « Données paires-sonnelles » : la CNIL réinvestit le jeu du Mémory pour apprendre à rendre vos traces en ligne moins visibles.

Après une rubrique réflexive, une rubrique plus directement activable, pour augmenter ses pratiques numériques d'un demi ton.

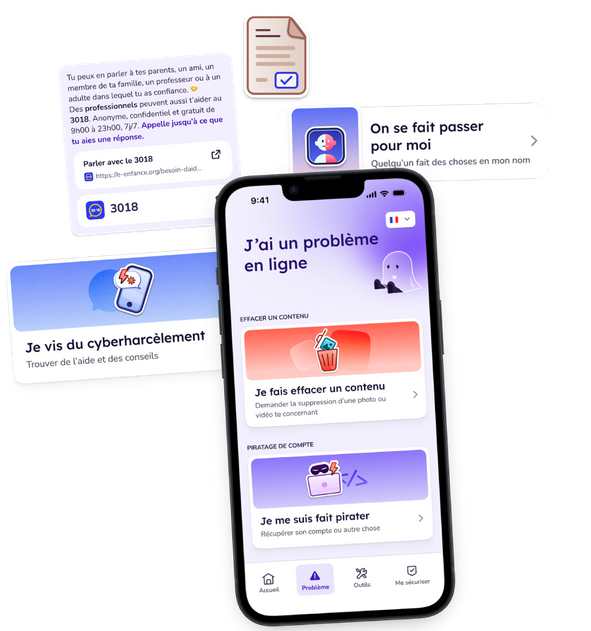

Avec FantomApp, protégez vos comptes réseaux sociaux et ceux de vos enfants.

Conçue par la CNIL pour aider les adolescents à garder le contrôle de leurs données sur les réseaux sociaux, l’application mobile FantomApp est un véritable vivier de ressources, à destination des jeunes, et de leurs parents.

Vous y trouverez tutos et conseils pour sécuriser vos comptes réseaux sociaux, trouver de l’aide en cas d’incident en ligne, et agir sur les paramètres à activer ou désactiver pour garder votre vie privée… privée.

Et comme les conseils ne vibrent vraiment que lorsqu’ils sont expérimentés, c’est à vous de jouer la partition !

L'application FantomApp

L'interlude : une respiration dans le flux, des dates pour aller écouter, ou voir des choses.

- Du 9 au 19 avril 2026, la BNF François Mitterrand accueille la première édition du festival NOÛS, une exploration artistique qui mêle IA et patrimoine pour interroger le futur de la création. Pendant dix jours, le festival mêle deux volets : un parcours d’œuvres, d’artistes français et internationaux, et des conférences à ne pas manquer.

- Le mardi 14 avril, l’événement Tech For Future, organisé conjointement par la tribune et BFM Business questionnera la souveraineté numérique européenne et présentera les stratégies et alliances déjà à l’œuvre.

- Du 13 mars au 27 septembre 2026, la Fondation groupe EDF présente l’exposition « Moi et les autres, regards d'artistes sur nos vies en ligne » qui propose d’explorer la manière dont internet et les réseaux sociaux modifient notre rapport à la sociabilité, à nous-mêmes, aux autres et au monde.

- Jusqu’au 18 juillet, Le Cube Garges présente l’exposition « Dopamine » à travers des œuvres et installations technocritiques pour comprendre l’économie de l’attention et la manière dont les algorithmes modèlent nos gestes et agissent sur notre chimie.

- Les Safer Internet Days se prolongent jusqu’à la fin du mois, et vous pouvez (re)visionner les webinaires d’Internet Sans Crainte / Tralalere pour prolonger la réflexion : Le bien-être numérique de nos enfants, parlons-en ! ainsi que L'IA et nos enfants, quel futur ensemble ?

Fin de transmission ! Merci pour votre lecture. Pour ne rien manquer des actualités du Conseil de l'IA et du numérique, restez à l'écoute sur notre site internet, et nos réseaux sociaux.